AIと個人情報保護:文科省が示す教育現場での安全なデータ利用

2026.04.19

AI時代の教育と個人情報保護:なぜ今、文部科学省の指針が重要なのか

近年、AI技術の進化は目覚ましく、教育現場でもその活用が急速に進んでいます。生成AIツールによる個別学習支援や、アダプティブラーニングシステムによる学習履歴の分析など、子どもたちの学びを豊かにする可能性が広がっています。しかし、その一方で、AIツールの利用に伴う個人情報の保護に対する懸念も高まっているのが現状です。

「みんなChatGPTを使っているのに、私だけ使わないのは損じゃない?」

ある日、中学生の子供がそう言ってきた時、私はAIが子どもたちの日常に浸透していることを改めて実感しました。私自身、教育ライターとして、この問いにどう答えるべきか考え、一緒にOECDの教育レポートを読み込み、「使っていいこと・ダメなこと」のリストを作成した経験があります。AIを「禁止」するだけでは、子どもたちの学びの機会を奪いかねません。大切なのは、AIを安全かつ効果的に使いこなすためのリテラシーを育むことであると考えられます。

このような背景から、文部科学省は教育現場でのAI利用に関するガイドラインを策定・改訂し、安全なデータ利用の道筋を示しています。この記事では、文部科学省の指針を基に、AIと個人情報保護について、子育て世代の方や教育関係者が理解しておくべきポイントを解説します。

文部科学省が示すAI利用ガイドラインの概要

文部科学省は、GIGAスクール構想の推進によりICT環境が整備された教育現場において、AIを安全に活用するための具体的な指針を提示しています。特に重要なのは、「教育情報セキュリティポリシーに関するガイドライン」の改訂や、生成AIに関する暫定的なガイドラインの提示です。

私は以前、教育系出版社に勤務しており、文部科学省のガイドライン改訂時には、出版社時代の人脈を通じて関係者の勉強会に参加する機会がありました。その際、難解な行政用語をいかに子育て世代の方や教育現場の先生方に「翻訳」して伝えるか、その必要性を強く感じました。

文部科学省の指針は、AIが教育活動を支援する強力なツールとなり得ることを認めつつも、個人情報の不適切な取り扱いによるリスクを最小限に抑えるためのルールを明確にしています。これは、子どもたちのプライバシーを守りながら、AIの恩恵を最大限に享受するためのバランスを追求するものです。

AI利用における個人情報保護の基本的な考え方

AIツールが教育現場で活用される際、最も重視されるべきは子どもたちの個人情報の保護です。ここでは、個人情報保護の基本的な概念と、教育現場での具体的な適用について解説します。

「個人情報」とは何か:教育データにおける範囲

個人情報保護法において「個人情報」とは、生存する個人に関する情報であって、特定の個人を識別できるものを指します。教育現場においては、以下のような情報が個人情報に該当すると考えられます。

- 氏名、生年月日、住所、電話番号、メールアドレス

- 学籍番号、出席番号

- 成績、学習履歴、健康診断の結果

- 顔写真、音声データ、動画データ

- 特定の個人を識別できるSNS投稿やウェブサイト閲覧履歴

これらの情報は、単独で個人を特定できなくても、他の情報と容易に照合できる場合、個人情報として扱われます。

「プライバシー」と「個人情報」の違い

「プライバシー」は、私生活を公開されない権利や、個人の尊厳に関わる情報を自己決定する権利といった、より広範な概念を指します。一方、「個人情報」はプライバシーを構成する要素の一つであり、法的に保護される具体的な情報の種類を指すことが多いです。教育現場では、個人情報の保護を通じて、子どもたちのプライバシー権を尊重することが求められます。

「目的外利用の禁止」と「同意の原則」

個人情報保護の根幹にあるのが、「目的外利用の禁止」と「同意の原則」です。

- 目的外利用の禁止: 収集した個人情報は、事前に特定した利用目的の範囲内でしか利用できません。例えば、学習履歴データを「学力向上」のために収集した場合、そのデータを「マーケティング」に利用することは許されません。

- 同意の原則: 個人情報を収集・利用する際は、原則として本人(未成年の場合は保護者)の同意が必要です。特に、要配慮個人情報(病歴や犯罪歴など)の取り扱いには、より厳格な同意が求められます。

教育現場でAIツールを利用する際は、これらの原則を常に念頭に置き、透明性の高い運用が不可欠です。

教育現場での具体的なAI利用と個人情報保護のポイント

文部科学省のガイドラインは、具体的なAIツールの利用場面を想定し、個人情報保護のための詳細な対策を提示しています。

1. 生成AIツールの利用

ChatGPTに代表される生成AIツールは、教材作成、アイデア出し、プログラミング学習など、多岐にわたる活用が期待されています。しかし、その特性上、個人情報の取り扱いには特に注意が必要です。

- 入力データと出力データの取り扱い:

- 個人情報を含まない入力: 原則として、氏名、住所、学籍番号、成績など、個人を特定できる情報を生成AIツールに入力することは避けるべきです。もし入力が必要な場合は、匿名化や仮名化を徹底し、個人が特定できない形に加工する必要があります。

- 出力データの確認: 生成AIが出力した情報に、意図せず個人情報や不適切な内容が含まれていないか、教員が必ず確認する体制が求められます。

- 学習履歴データの管理:

- 生成AIツールによっては、入力されたデータや利用履歴がAIの学習に利用される場合があります。この際、個人情報がAIの学習データとして蓄積され、意図せず外部に流出するリスクを理解しておく必要があります。

- 利用規約を十分に確認し、データがどのように利用・保存されるのかを把握することが重要です。

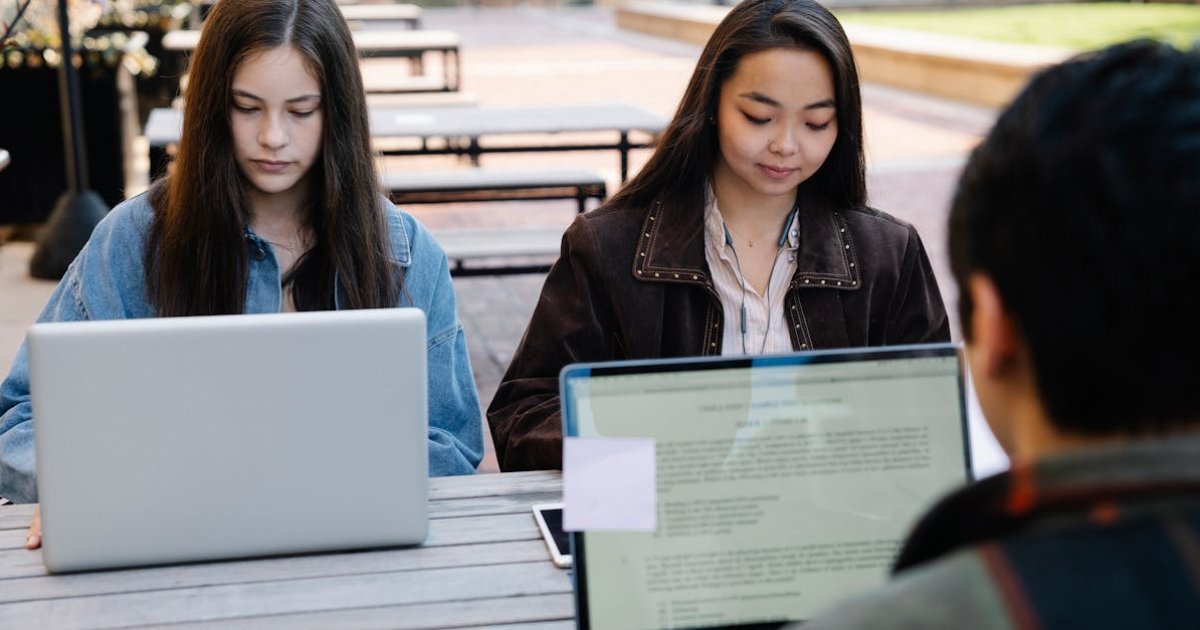

2. アダプティブラーニング(個別最適化された学び)

アダプティブラーニングシステムは、生徒一人ひとりの学習進度や理解度に合わせて、最適な教材や課題を提示するものです。このシステムは、大量の学習履歴データを蓄積・分析することで機能します。

- 学習履歴データの蓄積と分析:

- システムは、回答履歴、学習時間、正答率、苦手分野といった多様なデータを収集します。これらのデータは、生徒の学力向上という目的のためにのみ利用されるべきです。

- 収集されるデータの種類と利用目的を、生徒本人および保護者に対して明確に説明し、同意を得ることが重要です。

- データの利用目的の明確化と同意:

- どのようなデータを、何のために、どれくらいの期間利用するのかを具体的に提示します。

- 同意は、書面だけでなく、デジタルツール上での確認など、多様な方法が考えられます。

- データ共有におけるセキュリティ:

- 学習履歴データを学校内や教育委員会、または外部の事業者間で共有する際は、厳格なセキュリティ対策が講じられていることを確認する必要があります。

- データの暗号化、アクセス制限、定期的なセキュリティ監査などが挙げられます。

3. 教員のAI利用

教員がAIツールを教材作成や評価補助に活用する際も、個人情報保護への配慮が求められます。

- 教材作成、評価補助における注意点:

- AIに生徒の個人情報(例:特定の生徒の弱点、個別指導の記録)を入力して教材や評価レポートを作成する際は、個人が特定されないよう細心の注意を払う必要があります。

- 例えば、生徒の名前を匿名化したり、複数の生徒の情報をまとめて一般化したりするなどの工夫が考えられます。

- 生徒の個人情報を含むデータの取り扱い:

- AIツールが提供するデータ分析機能を利用する際も、生徒の成績や行動履歴などの個人情報が、適切に匿名化・統計処理されていることを確認します。

- 教員間での情報共有においても、必要最小限の範囲に留め、目的外利用を厳しく制限することが重要です。

4. 学校と外部事業者との連携

多くのAIツールやシステムは、外部のITベンダーによって提供されます。学校がこれらのサービスを利用する際は、事業者との間で個人情報保護に関する明確な契約を締結することが不可欠です。

- クラウドサービス利用時の契約内容確認:

- 個人情報の取り扱いに関する条項(利用目的、保存期間、セキュリティ対策、再委託の有無など)を詳細に確認します。

- データが保存されるサーバーの所在地(国内か海外か)も重要な確認事項です。

- セキュリティ対策の義務付け:

- 事業者が、適切な情報セキュリティ管理体制(ISMS認証の取得など)を確立しているか確認します。

- 万が一、情報漏洩が発生した場合の対応や責任範囲についても、事前に取り決めておく必要があります。

PTA役員としてICT活用方針会議に参加した際、私は「禁止より使い方を教えるべき」と意見しましたが、その議論は平行線に終わりました。このような状況では、感情論ではなく、文部科学省のガイドラインやOECDの教育レポートのようなエビデンスベースで、具体的なリスクと対策を伝えることの重要性を痛感します。

保護者・子育て世代の方に求められること

AI時代の子どもたちの学びを安全に支えるためには、学校任せにするのではなく、保護者自身も積極的に関わることが重要です。

1. 学校のICT活用方針への関心

- 学校がどのようなAIツールを導入し、どのように個人情報を取り扱うのか、定期的に学校からの情報提供を確認しましょう。

- 疑問や懸念がある場合は、遠慮なく学校に問い合わせ、説明を求めることが大切です。

- 学校説明会やPTA活動などを通じて、学校のICT活用方針について理解を深める機会を積極的に利用することが推奨されます。

2. 家庭でのAI利用ルールの設定

- 子どもたちが家庭でAIツールを利用する際、どのような情報を入力して良いのか、あるいは避けるべきなのか、家族で話し合い、ルールを設定することが有効です。

- 例えば、私の家庭では、中学生の子供と一緒にOECDの教育レポートを読み、「個人が特定できる情報は入力しない」「生成された情報を鵜呑みにしない」といった具体的なリストを作成しました。このような対話を通じて、子どもたちはAIリテラシーを自然と身につけていくことができます。

3. 子供との対話の重要性

- AIの利用に限らず、インターネット上の情報やプライバシーについて、日頃から子どもたちとオープンに話し合う機会を設けましょう。

- 子どもたちが困ったことや不安に感じたことを、いつでも大人に相談できる関係性を築くことが、トラブルを未然に防ぐ上で最も重要であると考えられます。

AI時代における教育の未来と、私たち大人の役割

AIは、子どもたちの可能性を広げ、学びを個別最適化する強力な「道具」です。しかし、その力を最大限に引き出し、同時にリスクを管理するためには、私たち大人が主体的に関わり続ける必要があります。

文部科学省のガイドラインは、そのための重要な羅針盤となります。私たちは、この指針を理解し、学校や地域社会、そして家庭で、AIの安全かつ効果的な活用について継続的に対話し、学び続ける役割を担っていると言えるでしょう。

AI技術はこれからも進化を続けます。それに伴い、ガイドラインも常に更新されていくことでしょう。変化の速い時代だからこそ、固定観念にとらわれず、常に最新の情報を学び、柔軟に対応していく姿勢が、子どもたちの未来を守るために不可欠であると考えられます。

まとめ

この記事では、文部科学省が示す教育現場でのAI利用における個人情報保護の指針について解説しました。

- 文部科学省のガイドラインは、AIの教育活用を推進しつつ、個人情報保護の重要性を強調しています。

- 個人情報保護の基本原則として、「目的外利用の禁止」や「同意の原則」が挙げられます。

- 具体的なAI利用場面(生成AI、アダプティブラーニングなど)ごとに、個人情報の入力制限、データ管理、セキュリティ対策が求められます。

- 保護者の方々には、学校の方針への関心、家庭でのルール設定、子どもとの対話が不可欠です。

AIは、子どもたちの学びを大きく変える可能性を秘めています。その恩恵を安全に享受するために、私たち大人一人ひとりが、個人情報保護に対する意識を高め、適切な知識を身につけることが、これからの教育現場に求められていると言えるでしょう。

関連記事

AIを活用した教材開発:文科省が推奨するデジタルコンテンツの方向性

文部科学省が推奨するAIを活用した新しい教材開発の方向性を解説。個別最適化された学習コンテンツの可能性を探ります。

沢田 由美 · 2026.04.26

沢田 由美 · 2026.04.26

文科省『情報活用能力』の定義改訂:AI時代に求められる新しいスキルとは?

文部科学省が改訂した「情報活用能力」の定義に基づき、AI時代に子どもたちが身につけるべき具体的なスキルや知識について解説します。

沢田 由美 · 2026.04.15

沢田 由美 · 2026.04.15

教員のためのAI研修ガイド:文科省推奨のスキルアップロードマップ

文部科学省が教員に求めるAIリテラシーと、それを習得するための研修プログラムや推奨される学習内容をロードマップ形式で紹介します。

沢田 由美 · 2026.04.12

沢田 由美 · 2026.04.12